Neural Machine käännös mahdollistaa ihmisen pariteetti innovaatiot pilvi

Maaliskuussa 2018 me Ilmoitti (Hassan et al. 2018) läpi murto tulos, jossa osoitimme ensimmäistä kertaa kone käännös järjestelmä, joka voisi suorittaa sekä ihmisten kääntäjiä (tietyssä skenaariossa-Kiina-Englanti News Translation). Tämä oli jännittävä läpi murto kone kääntäminen tutkimus, mutta järjestelmä rakensimme tähän hankkeeseen oli monimutkainen, raskaansarjan tutkimus järjestelmä, joka sisältää useita huippu luokan tekniikoita. Vaikka olemme julkaisseet tuotos tämän järjestelmän useita testi sarjoja, järjestelmä itsessään ei sovellu käyttöönottoon reaaliajassa kone käännös pilvi API.

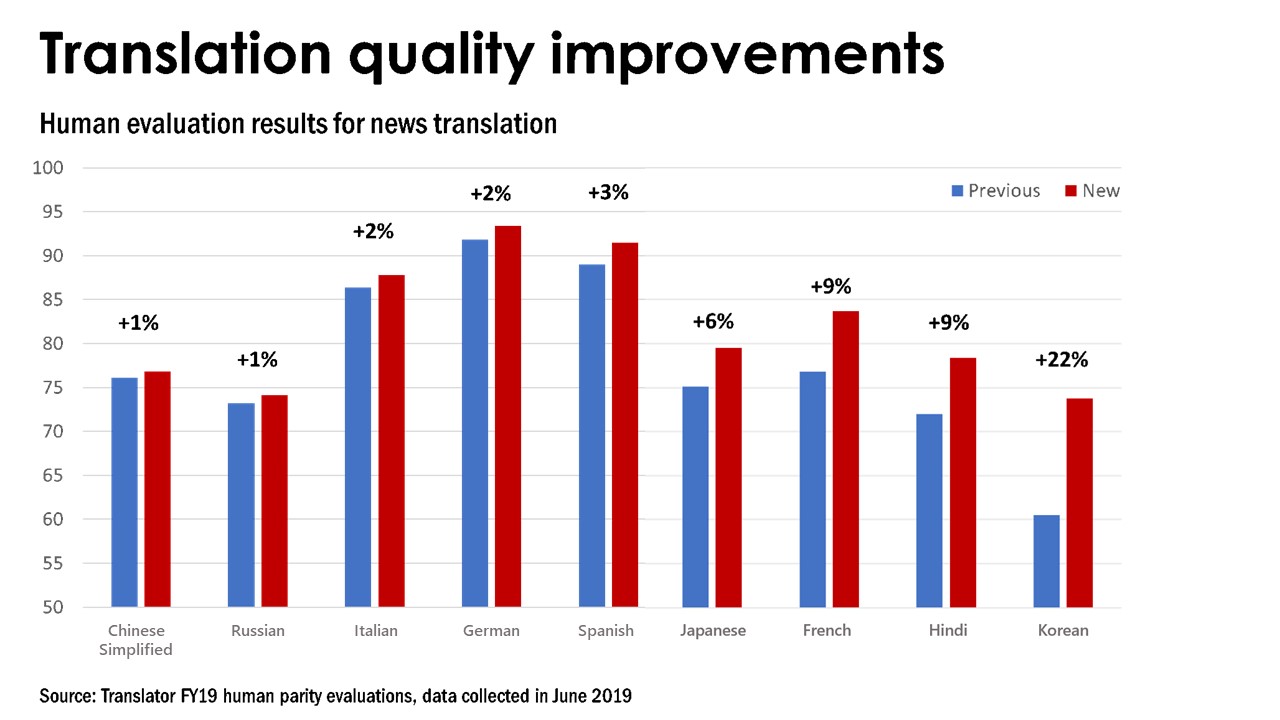

Tänään olemme iloisia voidessamme ilmoittaa saatavuus tuotannossa uusimman suku polven hermo kone käännös malleja. Nämä mallit sisältävät useimmat hyvyyden meidän tutkimus-järjestelmä ja ovat nyt saatavilla oletusarvoisesti, kun käytät Microsoft Translator API. Nämä uudet mallit ovat saatavilla tänään Kiina, Saksa, Ranska, hindi, Italia, Espanja, Japani, Korea ja Venäjä, ja Englanti. Lisää kieliä on tulossa pian.

Getting tutkimus paperi Cloud API

Kuluneen vuoden aikana olemme etsinyt tapoja tuoda paljon laatua meidän ihmisen pariteetti järjestelmän osaksi Microsoft Translator API, mutta tarjoaa edelleen edullisia reaaliaikaisia käännöksiä. Tässä muutamia vaiheita, että matka.

Teacher-Student Training

Ensimmäinen askel oli siirtyä "opettaja-opiskelija" puitteet, joissa koulutamme kevyt reaaliaikainen opiskelija jälseillä raskaansarjan opettajan verkko (BA ja Caruana 2014). Tämä saavutetaan kouluttamalla opiskelija ei ole rinnakkaisia tietoja, että MT järjestelmät ovat yleensä koulutettu, mutta käännökset tuottama opettaja (Kim ja Rush 2016). Tämä on yksinkertaisempi tehtävä kuin oppia raakadatan, ja sallii matalampi, yksinkertaisempi opiskelija hyvin tiiviisti seurata monimutkainen opettaja. Kuten voisi odottaa, meidän ensimmäiset yritykset vielä kärsinyt laatu putoaa opettajan opiskelija (ei ilmainen lounas!), mutta otimme kuitenkin ensimmäinen paikka WNMT 2018 jaettu tehtävä tehokas dekoodaus (Junczys-Dowmunt et al. 2018a). Joitakin erityisen jännittäviä tuloksia tästä vaivaa oli, että muuntaja (Vaswani et al. 2017) mallit ja niiden muutokset pelata hyvin opettajan ja opiskelijoiden koulutusta ja ovat yllättävän tehokas aikana päätellä suorittimen.

Oppiminen näistä alustavia tuloksia ja sen jälkeen paljon iteraation huomasimme resepti, jonka avulla meidän yksinkertainen opiskelija on lähes sama laatu kuin monimutkainen opettaja (joskus on ilmainen lounas loppujen lopuksi?). Nyt olimme vapaita rakentamaan suuria, monimutkaisia opettajan malleja maksimoida laatu, murehtimatta reaaliaikaisia rajoituksia (liikaa).

Reaaliaikainen käännös

Päätöksemme siirtyä opettajan ja oppilaan väliseen kehykseen motivoi suurta työtä Kim ja Rush (2016) yksinkertaisten RNN-pohjaisten mallien osalta. Tässä vaiheessa oli epäselvää, jos ilmoitetut hyödyt ilmenisivät myös Transformer-malleissa (ks. Vaswani et al. 2017 lisä tietoja tästä mallista). Havaitsimme kuitenkin nopeasti, että asia oli todellakin näin.

Transformer opiskelija voisi käyttää suuresti yksinkertaistettu dekoodaus algoritmi (ahne haku), jossa me vain valita yhden parhaan käännetty sana kussakin vaiheessa, eikä tavallista menetelmää (Beam-haku), joka liittyy hakuja valtava tilaa mahdollista Käännökset. Tämä muutos oli minimaalinen laatu vaikutus, mutta johti suuriin parannuksiin käännös nopeus. Sen sijaan, opettajan malli kärsisi merkittävää laskua laatu siirryttäessä Beam-Search on ahne-haku.

Samaan aikaan, huomasimme, että sen sijaan käyttää uusinta hermo-arkkitehtuurin (Transformer kanssa itsekiinnittävän) ja dekooderi, opiskelija voisi muuttaa käyttää huomattavasti yksinkertaistettu ja nopeampi toistuva (RNN) arkkitehtuuri. Tämä johtuu siitä, että vaikka Transformer Encoder voidaan laskea koko lähde lauseen rinnakkain, tavoite lause syntyy yksi sana kerrallaan, joten nopeus dekooderi on suuri vaikutus yleiseen nopeuteen käännöksen. Verrattuna itsekiinnittimeen, toistuva dekooderi vähentää algoritmisen monimutkaisuutta toisen asteen ja lineaarisen tavoite lauseen pituuden. Varsinkin opettaja-opiskelija-asetus, emme nähneet laadun heikkenemistä, koska nämä muutokset, ei automaattista eikä ihmisten arviointi tuloksia. Useat lisä parannukset, kuten parametrien jakaminen, johtivat monimutkaisuuden ja lisääntyneen nopeuden vähentämiseen entisestään.

Toinen etu opettajan ja opiskelijan puitteet olimme hyvin innoissaan siitä, että laadun parannuksia ajan alati kasvava ja muuttuvat opettajat ovat helposti kuljettaa yli muuttumaton opiskelija arkkitehtuuri. Tapa uksissa, joissa näimme tässä suhteessa ongelmia, opiskelijoiden malli kapasiteetin vähäinen kasvu kaventaisi jälleen kuilua.

Dual oppiminen

Kaksijakoisen oppimisen taustalla oleva keskeinen näkemys (Hän et al. 2016) on "edestakainen käännös" ruudullinen että ihmiset joskus apu jotta ruudullinen käännös avu. Oletetaan käytämme online kääntäjä mennä Englanti ja Italia. Jos emme lue Italiaa, miten tiedämme, jos se on tehnyt hyvää työtä? Ennen kuin napsautat Lähettää sähköpostitse, saatamme valita tarkistaa laadun kääntämällä Italian takaisin Englanti (ehkä eri Web-sivusto). Jos Englanti saamme takaisin on eksyneet liian kaukana alkuperäisestä, mahdollisuudet ovat yksi käännöksistä lähti kiskojen.

Dual oppiminen käyttää samaa lähestymis tapaa kouluttaa kaksi järjestelmää (esim. Englanti-> Italian ja Italian-> Englanti) rinnakkain, käyttäen edestakainen käännös yhdestä järjestelmästä Pisteet, validoida ja kouluttaa toisen järjestelmän.

Kaksois-oppiminen oli merkittävä tekijä inhimillisen pariteetti tutkimuksen tuloksemme. Kun menee tutkimus järjestelmästä meidän tuotanto resepti, me yleistynyt tätä lähestymis tapaa laajasti. Emme vain yhteistyössä kouluttaa paria järjestelmien toistensa tuotos, olemme myös käyttäneet samaa kriteeriä suodattamalla rinnakkaisia tietoja.

Virheellisten tietojen puhdistaminen

Kone käännös järjestelmät on koulutettu "rinnakkaisia tietoja", eli paria asia kirjoja, jotka ovat käännöksiä toistensa, ihanne tapauksessa luotu ihmisen kääntäjä. Kuten on käynyt ilmi, tämä rinnakkaiset tiedot ovat usein täynnä virheellisiä käännöksiä. Joskus asia kirjat eivät ole todella rinnakkaisia, mutta vain löysä parafraasit toisistaan. Ihmisen kääntäjät voivat halutessaan jättää pois joitakin lähde aineistoa tai lisätä lisä tietoja. Tiedot voivat sisältää kirjoitus virheitä, oikeinkirjoitus virheet, kieliopillisia virheitä. Joskus data mining algoritmeja huijatuksi samankaltaisia, mutta ei-rinnakkaisia tietoja, tai jopa lauseita väärällä kielellä. Mikä pahinta, paljon Web-sivuja näemme roska postia, tai voi itse asiassa olla kone käännöksiä eikä ihmisten käännöksiä. Neuraalilaskennan järjestelmät ovat hyvin herkkiä tällaista epätarkkuutta tiedoissa. Huomasimme, että rakennus hermo mallien automaattisesti tunnistaa ja päästä eroon näistä epätarkkuuksista antoi vahvan parannuksia laatuun järjestelmiemme. Lähestymis tapamme tietojen suodattamiseen johti ensimmäiseen WMT18 Parallel Corpus suodatus Benchmark (Junczys-Dowmunt 2018a) ja auttoi rakentamaan yksi vahvimmista Englanti-Saksa käännös järjestelmät WMT18 Uutiset käännös tehtävä (Junczys-Dowmunt 2018b). Olemme käyttäneet parannettu versioita tämän lähestymis tavan tuotanto järjestelmissä me julkaistiin tänään.

Laskelmiin Word edustustot

Kun tutkimus teknologiaa siirretään tuotantoon, syntyy useita reaalimaailman haasteita. Getting numeroita, päivä määrät, ajat, isojen kirjainten, välit, jne. oikeus asioita paljon enemmän tuotannossa kuin tutkimus järjestelmässä.

Harkitse haaste isojen kirjainten. Jos olemme kääntää lause "WATCH CAT videot HERE". Me osata kuinka jotta kääntää "katti". Halu amme kääntää "CAT" samalla tavalla. Mutta nyt harkita "Watch US Soccer täällä". Emme halua sekoittaa sanaa "meitä" ja lyhennettä "US" tässä yhteydessä.

Käsitellä tätä, käytimme lähestymis tapa tunnetaan laskelmiin Machine käännös (Koehn ja Hoang 2007, Sennrich ja Haddow 2016), joka toimii seuraavasti. Yhden numeerisen esityksen ("upottamisen") sijaan "Cat"-tai "CAT"-haussa käytämme useita upotuksisia, joita kutsutaan "tekijöiksi". Tässä tapa uksessa ensisijainen upottaminen olisi sama "CAT" ja "kissa", mutta erillinen tekijä edusta maan isojen kirjainten, joka osoittaa, että se oli all-caps yhdessä tapa uksessa, mutta pieniä muita. Samankaltaisia tekijöitä käytetään lähde-ja kohde puolella.

Käytämme samankaltaisia tekijöitä käsittelemään sana fragmentteja ja välejä sanojen välillä (monimutkainen ongelma ei-väli-tai puoli väli kielissä, kuten Kiina, Korea, Japani tai Thai).

Tekijät myös dramaattisesti parantunut käännös numeroita, joka on kriittinen monissa skenaarioissa. Numeroiden kääntäminen on enimmäkseen algoritmista muunnosta. Ajaksi esikuva, 1 234 000 kanisteri olla kirjallinen koska 12, 34000 kotona hindi, 1.234.000 kotona Germaani, ja 123,4 万 kotona Leuka. Perinteisesti luvut ovat edustettuina kuten sanat, kuten ryhmien merkkejä eripituisia. Tämä vaikeuttaa kone oppimisen löytää algoritmi. Sen sijaan, me rehu jokaisen numeron numero erikseen, joiden tekijät merkintä alussa ja lopussa. Tämä yksinkertainen temppu voimakkaasti ja luotettavasti poistaa lähes kaikki numero-käännös virheitä.

Nopeampi malli koulutus

Kun olemme koulutus yhden järjestelmän kohti yhtä tavoitetta, kuten teimme ihmis-pariteetti tutkimus hanke, odotamme heittää valtavan määrän laitteita malleja, jotka vievät viikkoja kouluttaa. Kun koulutus tuotanto malleja 20 + kieli paria, tämä lähestymis tapa tulee kestämätön. Meidän ei tarvitse vain kohtuullisen käänteen aikoihin, mutta meidän on myös kohtalainen meidän laitteisto vaatimuksiin. Tämän hankkeen osalta teimme useita suoritus kyvyn parannuksia Marian NMT (Junczys-Dowmunt et al. 2018b).

Marian NMT on avoimen lähde koodin Neural MT Toolkit, että Microsoft Kääntäjä perustuu. Marian on puhdas c + + hermo kone käännös Toolkit, ja sen seura uksena erittäin tehokas, ei vaadi GPU suorituksen, ja erittäin tehokas harjoittelu aikaa

Koska sen itsenäinen luonne, se on melko helppo optimoida Marian varten NMT erityisiä tehtäviä, joka johtaa yksi tehokkaimmista NMT työkaluja saatavilla. Tutustu Vertailuarvot. Jos olet kiinnostunut Neural MT tutkimus ja kehitys, ota liittyä ja edistää Community on GitHub.

Meidän parannuksia, jotka koskevat Mixed-Precision koulutus ja dekoodaus sekä suuri malli koulutus pian saataville julkisen GitHub repository.

Olemme innoissamme tulevaisuudesta neuraalilaskennan Machine käännös. Jatkamme uuden malli arkkitehtuurin pyörimisiä jäljellä oleville kielille ja Custom Kääntäjä koko tämän vuoden ajan. Käyttäjämme saavat automaattisesti huomattavasti laadukkaampia käännöksiä Translator APIMeidän Kääntäjä App, Microsoft Office ja Edge-selain. Toivomme, että uudet parannukset auttavat henkilökohtaista ja ammatillista työtäsi ja odottavat palautetta.

Viittaukset

- Jimmy BA ja Rich Caruana. 2014. Onko Deep Nets todella on syvä? Edistys askeleet Neural Information Processing Systems 27. Sivut 2654-2662. https://papers.nips.cc/paper/5484-do-deep-nets-really-need-to-be-deep

- Hany Hassan, Anthony Aue, Chang Chen, Vishal Chowdhary, Jonathan Clark, Christian Federmann, Xuedong Huang, Marcin Junczys-Dowmunt, William Lewis, mu Li, Shujie Liu, tie-Yan Liu, Renqian luo, Arul Menezes, Tao Qin, Frank Seide, Xu Tan, FEI Tian, Lijun Wu, Shuangzhi Wu, Yingce Xia, Dongdong Zhang, Zhirui Zhang, Ming Zhou. 2018. saavuttaminen ihmisen pariteetti on automaattinen Kiinan ja Englanti News Translation. http://arxiv.org/abs/1803.05567

- Hän, di ja Xia, Yingce ja Qin, Tao ja Wang, Liwei ja Yu, Nenghai ja Liu, tie-Yan ja ma, Wei-Ying. 2016. Dual oppiminen kone kääntäminen. Edistys askeleet Neural Information Processing Systems 29. Sivut 820-828. https://papers.nips.cc/paper/6469-dual-learning-for-machine-translation

- Marcin Junczys-Dowmunt. 2018a. Dual ehdollinen Cross-Entropy suodatus meluisa rinnakkainen corpora. Kone kääntämistä käsittelevän kolmannen konferenssin menettely: jaetut tehtävä paperit. Belgia, sivut 888-895. https://aclweb.org/anthology/papers/W/W18/W18-6478/

- Marcin Junczys-Dowmunt. 2018b. Microsoftin toimittamista WMT2018 Uutiset käännös tehtävä: Miten opin lopettamaan huolestuttava ja Love Data. Kone kääntämistä käsittelevän kolmannen konferenssin menettely: jaetut tehtävä paperit. Belgia, sivut 425-430. https://www.aclweb.org/anthology/W18-6415/

- Marcin Junczys-Dowmunt, Kenneth Heafield, Hieu Hoang, Roman Grundkiewicz, Anthony Aue. 2018a. Marian: kustannustehokas korkealaatuinen neuraalilaskennan Machine translation c + +. Menettely toinen työpaja Neural Machine käännös ja Generation. Melbourne, Australia, sivut 129-135. https://aclweb.org/anthology/papers/W/W18/W18-2716/

- Marcin Junczys-Dowmunt, Roman Grundkiewicz, Tomasz Dwojak, Hieu Hoang, Kenneth Heafield, Tom Neckermann, Frank Seide, Ulrich GERMANN, Alham Fikri Aji, Nikolay Bogoychev, André F. T. Martins, Alexandra Birch. 2018b. Marian: Nopea Neural Machine käännös c + +. Oikeuden käynnit ACL 2018, järjestelmän esittelyt. Melbourne, Australia, sivut 116-121. https://www.aclweb.org/anthology/P18-4020/

- Yoon Kim ja Alexander M. Rush. 2016. sekvenssin tason tietämyksen tislaus. Vuonna 2016 konferenssin empiirisiä menetelmiä Natural Language Processing, EMNLP 2016, Austin, Texas, USA, Marraskuu 1-4, 2016, sivut 1317-1327. https://aclweb.org/anthology/papers/D/D16/D16-1139/

- Philipp Koehn, Hieu Hoang. 2007. laskelmiin käännös mallit. 2007 yhteisessä konferenssissa, jossa käsitellään empiirisiä menetelmiä luonnollisen kielen jalostuksen ja laskennallisen luonnollisen kielen oppimisen osalta. Praha, Tsekin tasa valta, sivut 868-876. https://www.aclweb.org/anthology/D07-1091/

- Rico Sennrich, Barry Haddow. 2016. kielelliset tulo ominaisuudet paran tavat hermo kone käännöstä. Ensimmäisen kone käännös konferenssin käsittely: Volume 1, tutkimus paperit. Berliini, Saksa, sivut 83-91. https://www.aclweb.org/anthology/W16-2209/

- Vaswani, Ashish ja shazeer, Noam ja Parmar, Niki ja Uszkoreit, Jakob ja Jones, Llion ja Gomez, aidan N ja Kaiser, Lukasz ja Polosukhin, Illia. 2017. huomio on kaikki mitä tarvitset. Edistys askeleet Neural Information Processing Systems 30. Sivut 5998-6008. https://papers.nips.cc/paper/7181-attention-is-all-you-need