Νευρολογική μηχανική μετάφραση ενεργοποίηση καινοτομιών ανθρώπινης ισοτιμίας στο cloud

Τον Μάρτιο του 2018 Ανακοίνωσε (Χασάν et al. 2018) ένα σημαντικό αποτέλεσμα όπου δείξαμε για πρώτη φορά ένα σύστημα μηχανικής μετάφρασης που θα μπορούσε να εκτελέσει καθώς και μεταφραστές του ανθρώπου (σε ένα συγκεκριμένο σενάριο – μετάφραση κινεζικών-Αγγλικών ειδήσεων). Αυτό ήταν μια συναρπαστική ανακάλυψη στην έρευνα μηχανικής μετάφρασης, αλλά το σύστημα που χτίσαμε για αυτό το έργο ήταν ένα σύνθετο, βαρέων βαρών ερευνητικό σύστημα, ενσωματώνοντας πολλαπλές τεχνικές αιχμής. Ενώ κυκλοφορήσαμε την έξοδο αυτού του συστήματος σε διάφορα σύνολα δοκιμών, το ίδιο το σύστημα δεν ήταν κατάλληλο για ανάπτυξη σε πραγματικό χρόνο cloud μετάφραση σύννεφο API.

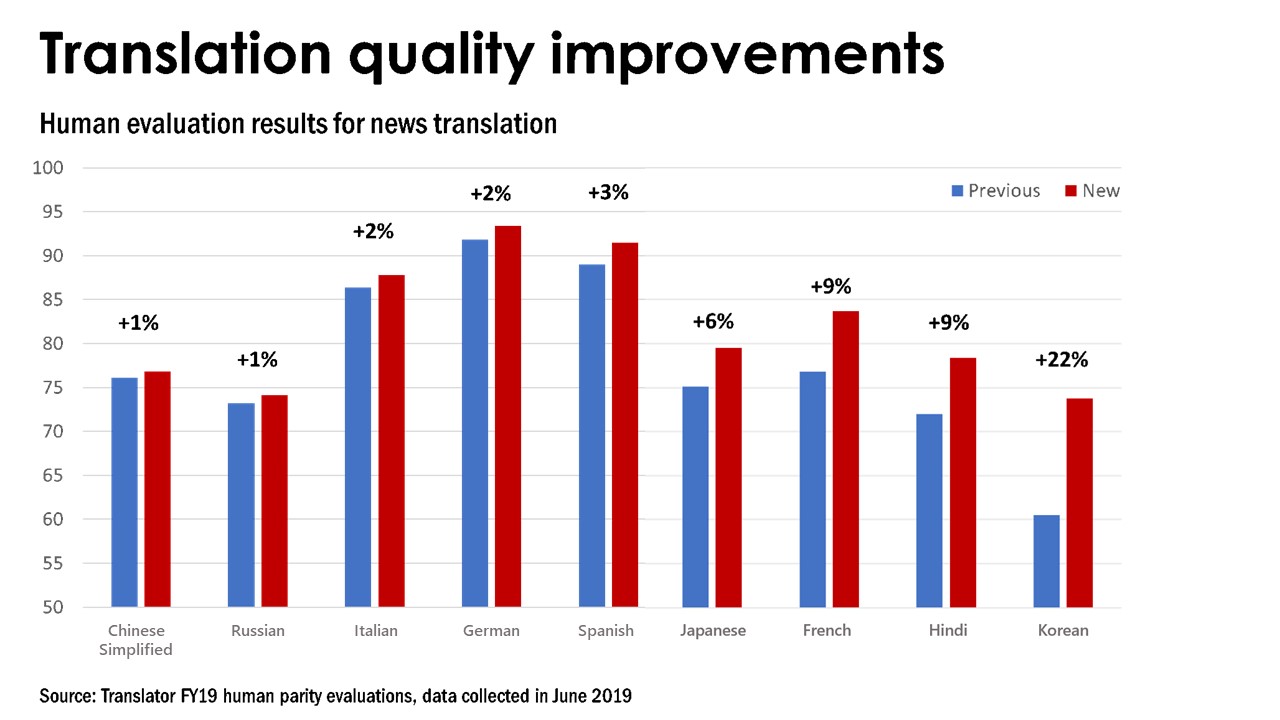

Σήμερα είμαστε ενθουσιασμένοι να ανακοινώσουμε τη διαθεσιμότητα στην παραγωγή της τελευταίας γενιάς μας μοντέλα νευρωνικών μηχανών μετάφρασης. Αυτά τα μοντέλα ενσωματώνουν το μεγαλύτερο μέρος της καλοσύνης του ερευνητικού μας συστήματος και τώρα είναι διαθέσιμα από προεπιλογή όταν χρησιμοποιείτε το API μετάφρασης της Microsoft. Αυτά τα νέα μοντέλα είναι διαθέσιμα σήμερα στα κινέζικα, Γερμανικά, Γαλλικά, Χίντι, Ιταλικά, Ισπανικά, Ιαπωνικά, Κορεατικά, και Ρωσικά, από και προς τα αγγλικά. Περισσότερες γλώσσες έρχονται σύντομα.

Λήψη από το ερευνητικό χαρτί στο cloud API

Κατά τη διάρκεια του περασμένου έτους, αναζητούμε τρόπους για να φέρουμε μεγάλο μέρος της ποιότητας του συστήματος ανθρώπινης ισοτιμίας στο Microsoft API μετάφρασης, ενώ συνεχίζουν να προσφέρουν χαμηλού κόστους μετάφραση σε πραγματικό χρόνο. Εδώ είναι μερικά από τα βήματα σε αυτό το ταξίδι.

Εκπαίδευση δασκάλων-φοιτητών

Το πρώτο μας βήμα ήταν η μετάβαση σε ένα πλαίσιο «δασκάλου-μαθητή», όπου εκπαιδεύουμε έναν ελαφρύ μαθητή σε πραγματικό χρόνο να μιμείται ένα δίκτυο δασκάλων βαρέων βαρών (Μπα και Καρουάνα 2014). Αυτό επιτυγχάνεται με την εκπαίδευση του φοιτητή όχι στα παράλληλα δεδομένα στα οποία συνήθως εκπαιδεύονται τα συστήματα MT, αλλά στις μεταφράσεις που παράγει ο εκπαιδευτικός (Κιμ και Ρας 2016). Αυτό είναι ένα απλούστερο έργο από τη μάθηση από τα ακατέργαστα δεδομένα, και επιτρέπει σε έναν πιο ρηχό, απλούστερο μαθητή να παρακολουθήσει πολύ στενά τον σύνθετο δάσκαλο. Όπως θα περίμενε κανείς, οι αρχικές προσπάθειές μας εξακολουθούσαν να υποφέρουν από ποιοτικές πτώσεις από δάσκαλο σε μαθητή (χωρίς δωρεάν γεύμα!), αλλά παρ ' όλα αυτά πήραμε την πρώτη θέση στο κοινό έργο WNMT 2018 για την αποτελεσματική αποκωδικοποίηση (Junczys-Dowmunt et al. 2018 a). Μερικά ιδιαίτερα συναρπαστικά αποτελέσματα από αυτή την προσπάθεια ήταν ότι ο μετασχηματιστής (Βασάνι et al. 2017) τα μοντέλα και οι τροποποιήσεις τους παίζουν καλά με την εκπαίδευση εκπαιδευτικών-φοιτητών και είναι εκπληκτικά αποδοτικά κατά τη διάρκεια της ΕΠΕΞΕΡΓΑΣΊΑς.

Μαθαίνοντας από αυτά τα αρχικά αποτελέσματα και μετά από πολλές διαδοχικές ανακαλύψεις ανακαλύψαμε μια συνταγή που επιτρέπει στον απλό μαθητή μας να έχει σχεδόν την ίδια ποιότητα με τον σύνθετο δάσκαλο (μερικές φορές υπάρχει ένα δωρεάν γεύμα τελικά;). Τώρα ήμασταν ελεύθεροι να οικοδομήσουμε μεγάλα, πολύπλοκα μοντέλα εκπαιδευτικών για να μεγιστοποιήσουμε την ποιότητα, χωρίς να ανησυχούμε για περιορισμούς σε πραγματικό χρόνο (πάρα πολύ).

Μετάφραση σε πραγματικό χρόνο

Η απόφασή μας να αλλάξουμε σε ένα πλαίσιο εκπαιδευτικού-μαθητή είχε ως κίνητρο το μεγάλο έργο της Kim και βιασύνη (2016) για απλά μοντέλα που βασίζονται σε RNN. Σε αυτό το σημείο δεν ήταν σαφές αν τα αναφερόμενα οφέλη θα εκδηλωθούν και για τα μοντέλα μετασχηματιστών (βλέπε Βασάνι et al. 2017 για λεπτομέρειες σχετικά με αυτό το μοντέλο). Ωστόσο, ανακαλύψαμε γρήγορα ότι αυτό συνέβη πράγματι.

Ο φοιτητής μετασχηματιστής θα μπορούσε να χρησιμοποιήσει ένα πολύ απλοποιημένο αλγόριθμο αποκωδικοποίησης (άπληστη αναζήτηση), όπου απλά να επιλέξετε το μοναδικό καλύτερο μεταφρασμένο λέξη σε κάθε βήμα, αντί της συνήθους μεθόδου (ακτίνα-αναζήτηση) που περιλαμβάνει την αναζήτηση μέσα από το τεράστιο χώρο της πιθανής Μεταφράσεις. Αυτή η αλλαγή είχε ελάχιστο ποιοτικό αντίκτυπο, αλλά οδήγησε σε μεγάλες βελτιώσεις στην ταχύτητα μετάφρασης. Αντίθετα, ένα μοντέλο εκπαιδευτικών θα υποστεί μια σημαντική πτώση της ποιότητας κατά την εναλλαγή από την αναζήτηση δοκού σε άπληστη-αναζήτηση.

Ταυτόχρονα, συνειδητοποιήσαμε ότι αντί να χρησιμοποιούμε την τελευταία νευρική αρχιτεκτονική (μετασχηματιστής με αυτοπροσοχή) στον αποκωδικοποιητή, ο μαθητής μπορούσε να τροποποιηθεί για να χρησιμοποιήσει μια δραστικά απλοποιημένη και ταχύτερη επαναλαμβανόμενη αρχιτεκτονική (RNN). Αυτό έχει σημασία επειδή ενώ ο κωδικοποιητής μετασχηματιστής μπορεί να υπολογιστεί σε ολόκληρη την πρόταση πηγής παράλληλα, η πρόταση στόχος δημιουργείται μία μόνο λέξη κάθε φορά, έτσι ώστε η ταχύτητα του αποκωδικοποιητή να έχει μεγάλο αντίκτυπο στη συνολική ταχύτητα της μετάφρασης. Σε σύγκριση με την αυτοπροσοχή, ο επαναλαμβανόμενος αποκωδικοποιητής μειώνει την αλγοριθμική πολυπλοκότητα από τετραγωνική σε γραμμική στο μήκος της πρότασης στόχου. Ειδικά στο σκηνικό του δασκάλου-μαθητή, δεν είδαμε καμία απώλεια στην ποιότητα λόγω αυτών των τροποποιήσεων, ούτε για αυτόματη ούτε για αποτελέσματα ανθρώπινης αξιολόγησης. Αρκετές πρόσθετες βελτιώσεις, όπως η κοινή χρήση παραμέτρων, οδήγησαν σε περαιτέρω μειώσεις της πολυπλοκότητας και αυξημένη ταχύτητα.

Ένα άλλο πλεονέκτημα του πλαισίου εκπαιδευτικών-φοιτητών που ήμασταν πολύ ενθουσιασμένοι που είδαμε είναι ότι οι βελτιώσεις της ποιότητας με την πάροδο του χρόνου των ολοένα αυξανόμενων και μεταβαλλόμενων εκπαιδευτικών μεταφέρονται εύκολα σε μια μη μεταβαλλόμενη φοιτητική αρχιτεκτονική. Σε περιπτώσεις όπου είδαμε προβλήματα από αυτή την άποψη, οι ελαφρές αυξήσεις στην ικανότητα του μαθητικού μοντέλου θα κλείσουν και πάλι το χάσμα.

Διπλή μάθηση

Οι βασικές πληροφορίες πίσω από τη διττή μάθηση (Έκανε το 2016.) είναι ο έλεγχος "μετάφρασης μετ ' επιστροφής" που οι άνθρωποι χρησιμοποιούν μερικές φορές για να ελέγξουν την ποιότητα της μετάφρασης. Ας υποθέσουμε ότι χρησιμοποιούμε ένα διαδικτυακό μεταφραστή για να πάμε από τα αγγλικά στα ιταλικά. Αν δεν διαβάσουμε Ιταλικά, πώς θα ξέρουμε αν έχει γίνει καλή δουλειά; Πριν κάνετε κλικ στο κουμπί Στείλτε σε ένα email, μπορεί να επιλέξουμε να ελέγξουμε την ποιότητα μεταφράζοντας την ιταλική πλάτη στα Αγγλικά (ίσως σε διαφορετική ιστοσελίδα). Αν τα Αγγλικά που επιστρέφουμε έχουν απομακρυνθεί πολύ από το αρχικό, οι πιθανότητες είναι ότι μία από τις μεταφράσεις βγήκε από τις ράγες.

Η διπλή μάθηση χρησιμοποιεί την ίδια προσέγγιση για να εκπαιδεύσει δύο συστήματα (π.χ. Αγγλικά-Ιταλικά και Ιταλικά-Αγγλικά) Παράλληλα, χρησιμοποιώντας τη μετάφραση μετ ' επιστροφής από ένα σύστημα για να σκοράρει, να επικυρώσει και να εκπαιδεύσει το άλλο σύστημα.

Η διπλή μάθηση αποτέλεσε σημαντικό παράγοντα στο αποτέλεσμα της έρευνας για την ανθρώπινη ισοτιμία. Πηγαίνοντας από το ερευνητικό σύστημα στη συνταγή παραγωγής μας, γενικευμένο αυτή η προσέγγιση σε γενικές γραμμές. Όχι μόνο συγεκπαιδεύουμε ζεύγη συστημάτων στην παραγωγή του άλλου, αλλά χρησιμοποιήσαμε και το ίδιο κριτήριο για το φιλτράρισμα των παράλληλων δεδομένων μας.

Καθαρισμός ανακριβών δεδομένων

Τα συστήματα μηχανικής μετάφρασης εκπαιδεύονται σε "παράλληλα δεδομένα", δηλαδή ζεύγη εγγράφων που είναι μεταφράσεις το ένα στο άλλο, ιδανικά δημιουργημένη από έναν μεταφραστή ανθρώπων. Όπως αποδεικνύεται, αυτά τα παράλληλα δεδομένα είναι συχνά γεμάτα ανακριβείς μεταφράσεις. Μερικές φορές τα έγγραφα δεν είναι πραγματικά παράλληλα, αλλά μόνο χαλαρές παραφράσεις μεταξύ τους. Οι άνθρωποι μεταφραστές μπορούν να επιλέξουν να αφήσουν έξω κάποιο υλικό πηγής ή να εισαγάγουν πρόσθετες πληροφορίες. Τα δεδομένα μπορούν να περιέχουν τυπογραφικά σφάλματα, ορθογραφικά λάθη, γραμματικές λάθη. Μερικές φορές οι αλγόριθμοι εξόρυξης δεδομένων ξεγελαστούν από παρόμοια αλλά μη παράλληλα δεδομένα, ή ακόμη και από προτάσεις σε λάθος γλώσσα. Το χειρότερο από όλα, πολλές από τις ιστοσελίδες που βλέπουμε είναι spam, ή μπορεί στην πραγματικότητα να είναι μηχανές μεταφράσεις αντί για ανθρώπινες μεταφράσεις. Τα νευρικά συστήματα είναι πολύ ευαίσθητα σε αυτού του είδους την ανακρίβεια στα δεδομένα. Βρήκαμε ότι το κτίριο νευρικά μοντέλα για την αυτόματη ταυτοποίηση και να απαλλαγούμε από αυτές τις ανακρίβειες έδωσε ισχυρές βελτιώσεις στην ποιότητα των συστημάτων μας. Η προσέγγισή μας στο φιλτράρισμα δεδομένων είχε ως αποτέλεσμα την πρώτη θέση Δείκτης αναφοράς παράλληλου φιλτραρίσματος WMT18 (Junczys-Dowmunt 2018 a) και συνέβαλε στην οικοδόμηση ενός από τα ισχυρότερα Αγγλικά-Γερμανικά WMT18 εργασία μετάφρασης ειδήσεων (Γιούνγκζις-Ντμάντ 2018 β). Χρησιμοποιήσαμε βελτιωμένες εκδοχές αυτής της προσέγγισης στα συστήματα παραγωγής που κυκλοφορήσαμε σήμερα.

Συνυπολογίζοντας το Word αναπαραστάσεις

Κατά τη μετακίνηση μιας ερευνητικής τεχνολογίας στην παραγωγή, ανακύπτουν αρκετές προκλήσεις του πραγματικού κόσμου. Οι αριθμοί, οι ημερομηνίες, οι χρόνοι, η κεφαλαιοποίηση, η απόσταση, κ. λπ., έχουν σημασία πολύ περισσότερο στην παραγωγή παρά σε ένα ερευνητικό σύστημα.

Εξετάστε την πρόκληση της κεφαλαιοποίησης. Αν μεταφράζουμε την πρόταση "Παρακολουθήστε τα βίντεο CAT εδώ". Ξέρουμε πώς να Μεταφράζουμε το "Cat". Θα θέλαμε να μεταφράσουμε το "CAT" με τον ίδιο τρόπο. Αλλά τώρα σκεφτείτε "Παρακολουθήστε μας ποδόσφαιρο εδώ". Δεν θέλουμε να συγχέουμε τη λέξη "εμείς" και το ακρωνύμιο "ΗΠΑ" σε αυτό το πλαίσιο.

Για να το χειριστούμε αυτό, χρησιμοποιήσαμε μια προσέγγιση γνωστή ως μηχανική μετάφραση (Κόεον και ΕΜΙ 2007, Sennrich και Haddow 2016), η οποία λειτουργεί ως ακολούθως. Αντί για μια μεμονωμένη αριθμητική αναπαράσταση ("ενσωμάτωση") για "Cat" ή "CAT", χρησιμοποιούμε πολλαπλά ενσωματώσεων, γνωστά ως "παράγοντες". Σε αυτή την περίπτωση, η κύρια ενσωμάτωση θα είναι η ίδια για το "CAT" και "Cat", αλλά ένας ξεχωριστός παράγοντας θα αντιπροσώπευε την κεφαλαιοποίηση, δείχνοντας ότι ήταν όλα κεφαλαία σε μία περίπτωση αλλά πεζά στο άλλο. Παρόμοιοι παράγοντες χρησιμοποιούνται στην πηγή και την πλευρά του στόχου.

Χρησιμοποιούμε παρόμοιους παράγοντες για να χειριστούμε τα τμήματα του Word και την απόσταση μεταξύ των λέξεων (ένα σύνθετο ζήτημα σε γλώσσες μη απόστασης ή ημι-απόστασης, όπως κινέζικα, Κορεατικά, Ιαπωνικά ή ταϊλανδέζικα).

Παράγοντες επίσης δραματικά βελτιωμένη μετάφραση των αριθμών, η οποία είναι κρίσιμη σε πολλά σενάρια. Η μετάφραση αριθμών είναι ως επί το πλείστον μια αλγοριθμική μεταμόρφωση. Για παράδειγμα, 1.234.000 μπορεί να γραφτεί ως 12, 34000 στα Χίντι, 1.234.000 στα Γερμανικά, και 123,4 万 στα κινέζικα. Παραδοσιακά, οι αριθμοί αναπαριστώνται σαν λέξεις, ως ομάδες χαρακτήρων διαφορετικού μήκους. Αυτό καθιστά δύσκολο για την εκμάθηση μηχανών να ανακαλύψει τον αλγόριθμο. Αντ ' αυτού, τροφοδοουμε κάθε ψηφίο ενός αριθμού ξεχωριστά, με παράγοντες που σηματοδοούν την αρχή και το τέλος. Αυτό το απλό τέχνασμα με σταθερά και αξιόπιστα αφαιρέσει σχεδόν όλα τα σφάλματα σειράς-μετάφρασης.

Ταχύτερη εκπαίδευση μοντέλο

Όταν εκπαιδεύουμε ένα ενιαίο σύστημα προς ένα μόνο στόχο, όπως κάναμε για το ερευνητικό έργο ανθρώπινης ισοτιμίας, αναμένουμε να πετάξουμε τεράστιους αριθμούς υλικού σε μοντέλα που θα χρειαστούν εβδομάδες για να προπονηθώ. Κατά την κατάρτιση μοντέλων παραγωγής για ζεύγη γλωσσών 20 +, η προσέγγιση αυτή καθίσταται αβάσιμη. Όχι μόνο χρειαζόμαστε λογικές στιγμές, αλλά πρέπει επίσης να μετριά-σουμε τις απαιτήσεις μας για το υλικό. Για το έργο αυτό, κάναμε μια σειρά από βελτιώσεις στις επιδόσεις Μάριαν NMT (Junczys-Dowmunt et al. 2018 b).

Η Μάριαν NMT είναι το εργαλείο νευρωνικών MT ανοιχτής πηγής που βασίζεται στη Microsoft μεταφράστρια. Η Μάριαν είναι ένα καθαρό κιτ εργαλείων μετάφρασης νευρωνικών μηχανών C++, και, ως αποτέλεσμα, εξαιρετικά αποτελεσματικό, δεν απαιτεί GPUs κατά το χρόνο εκτέλεσης, και πολύ αποτελεσματικό κατά το χρόνο προπόνησης

Λόγω της αυτοπεριορισμένης φύσης του, είναι αρκετά εύκολο να βελτιστοποιήσετε τη Μάριαν για συγκεκριμένες εργασίες του NMT, γεγονός που οδηγεί σε ένα από τα πιο αποτελεσματικά διαθέσιμα κιτ εργαλείων NMT. Ρίξε μια ματιά στο Σημεία αναφοράς. Αν ενδιαφέρεστε για την έρευνα και την ανάπτυξη των νευρικών MT, παρακαλούμε να συμμετάσχετε και να συμβάλλετε στην Κοινότητα στο GitHub.

Οι βελτιώσεις μας σχετικά με την εκπαίδευση και αποκωδικοποίηση μεικτής ακρίβειας, καθώς και για την κατάρτιση μεγάλου μοντέλου θα διατεθούν σύντομα στο δημόσιο αποθετήριο GitHub.

Είμαστε ενθουσιασμένοι για το μέλλον της νευρομηχανικής μετάφρασης. Θα συνεχίσουμε να ανοίγουμε τη νέα αρχιτεκτονική μοντέλων στις υπόλοιπες γλώσσες και Προσαρμοσμένος Μεταφραστής καθ ' όλη τη διάρκεια του έτους. Οι χρήστες μας θα πάρουν αυτόματα τις σημαντικά καλύτερης ποιότητας μεταφράσεις μέσω της API μετάφρασηςΜας Εφαρμογή μεταφράστρια, Το Microsoft Office και το πρόγραμμα περιήγησης Edge. Ελπίζουμε ότι οι νέες βελτιώσεις θα βοηθήσουν την προσωπική και επαγγελματική σας ζωή και θα προσβλέπουμε στα σχόλιά σας.

Αναφορές

- Τζίμι Μπα και Ριτς Καρουάνα. 2014. τα βαθιά δίχτυα πρέπει πραγματικά να είναι βαθιά; Εξελίξεις στα νευρικά συστήματα επεξεργασίας πληροφοριών 27. Σελίδες 2654-2662. https://papers.nips.cc/paper/5484-do-deep-nets-really-need-to-be-deep

- Χάνι Χασάν, Άντονι Τσούν, Τσανγκ Τσεν, Βισάλ Τσόισαρι, Τζόναθαν Κλαρκ, Κρίστιαν Φέντμαν, Σιέντονγκ Χουάνγκ, Μαρσίν Γιούνγκρις-Νταμάντ, Γουίλιαμ Λούις, μου Λι, Σουτζι Λιού, Τσου-Γιαν Λιού, Ρενιάν Λούο, Αρούλ Μενέις, Τάο Κιν, Φρανκ Σεγίδη, Γου Ταν, Φέι Τιάν Σουανγκγκζι Γου, γκεζς ξιά, Ντόνγκντονγκ Ζανγκ, Ζιρούι Ζανγκ, Μινγκ Ζου. 2018. επίτευξη ανθρώπινης ισοτιμίας στις αυτόματες κινέζικες μεταφραστικές ειδήσεις. http://arxiv.org/abs/1803.05567

- Αυτός, ο Ντι και η ξιά, η Yingce και ο Qin, ο Τάο και ο Γουάνγκ, ο Λιγουέι και ο Γιού, ο Νενχάι και ο Λιου, ο Τζε-Γιαν και η μαμά, η Γουέι-Γινγκ. 2016. διπλή μάθηση για μηχανική μετάφραση. Εξελίξεις στα νευρικά συστήματα επεξεργασίας πληροφοριών 29. Σελίδες 820-828. https://papers.nips.cc/paper/6469-dual-learning-for-machine-translation

- Μαρσίν Γιούντσις-Ντόμουτ. 2018 α. διπλή υποτροπία με όρους διασταυρούμενη εντροπία των θορυβωδών παράλληλων επιχειρήσεων. Διαδικασία της τρίτης Διάσκεψης για τη μηχανική μετάφραση: κοινόχρηστα έγγραφα εργασίας. Βέλγιο, σελίδες 888-895. https://aclweb.org/anthology/papers/W/W18/W18-6478/

- Μαρσίν Γιούντσις-Ντόμουτ. 2018 β. υποβολή της Microsoft στο έργο μετάφρασης WMT2018 News: πώς έμαθα να σταματάω να ανησυχώ και να αγαπώ τα δεδομένα. Διαδικασία της τρίτης Διάσκεψης για τη μηχανική μετάφραση: κοινόχρηστα έγγραφα εργασίας. Βέλγιο, σελίδες 425-430. https://www.aclweb.org/anthology/W18-6415/

- Μαρσίν Γιούνγκρις-Ντόμμουτ, Κένεθ Heafield 2018 α. Μάριαν: οικονομικά αποδοτική υψηλής ποιότητας Νευρομηχανική μετάφραση σε C++. Εργασίες του 2ο εργαστηρίου για τη μετάφραση και γενιά της νευρωνικής μηχανής. Μελβούρνη, Αυστραλία, σελίδες 129-135. https://aclweb.org/anthology/papers/W/W18/W18-2716/

- Μάρσιν Γιούντσρις-Νταμούντ, Ρόμαν Μέτκιβιτς, Τόμας Ντιγούακ, Χεε Φετς, Κένεθ Heafield, Τομ Νεκκέρμαν, Φρανκ Σέιντε, Ούλριχ Γκέρμαν, Άλχαμ Φικρί Τζι, Νικολάι Μπογκσόεφ, Αντρέ φ 2018 β. Μαριαν: γρήγορο νευρωνικό μηχάνημα μετάφραση σε C++. Διαδικασίες της ACL 2018, επιδείξεις συστήματος. Μελβούρνη, Αυστραλία, σελίδες 116-121. https://www.aclweb.org/anthology/P18-4020/

- Γιουν Κιμ και Αλεξάντερ μ. Ρας. 2016. απόσταξη γνώσεων σε επίπεδο ακολουθίας. Στη διαδικασία της 2016 διάσκεψης για τις εμπειρικές μεθόδους επεξεργασίας φυσικής γλώσσας, EMNLP 2016, Όστιν, Τέξας, ΗΠΑ, 1-4 Νοεμβρίου, 2016, Pages 1317 – 1327. https://aclweb.org/anthology/papers/D/D16/D16-1139/

- Φίλιππ Κόεουν 2007. μοντέλα μετάφρασης. Διαδικασία της κοινής Διάσκεψης 2007 για τις εμπειρικές μεθόδους στην επεξεργασία της φυσικής γλώσσας και την υπολογιστική φυσική μάθηση (EMNLP-CoNLL). Πράγα, Τσεχική Δημοκρατία, σελίδες 868-876. https://www.aclweb.org/anthology/D07-1091/

- Ρίκο Σεννριτς, Μπάρι Χέιλοου. 2016. γλωσσικά χαρακτηριστικά εισόδου βελτίωση της νευρομηχανικής μετάφρασης. Διαδικασία της πρώτης διάσκεψης για τη μηχανική μετάφραση: τόμος 1, ερευνητικά έγγραφα. Βερολίνο, Γερμανία, σελίδες 83-91. https://www.aclweb.org/anthology/W16-2209/

- Ο βασάνι, ο Ασίς και η Σέζερ, ο Νόαμ και ο Παρμάρ, η Νίκι και ο Ουζκόρειτ, ο Τζέικομπ και ο Τζόουνς, ο Λλέον και ο Γκόμεζ, ο Έινταν ν και ο Κάιζερ, ο Λουκάζ και ο Πολοσουτσιν, Ιλλία. 2017. η προσοχή είναι το μόνο που χρειάζεστε. Εξελίξεις στα νευρικά συστήματα επεξεργασίας πληροφοριών 30. Σελίδες 5998-6008. https://papers.nips.cc/paper/7181-attention-is-all-you-need