“Microsoft AI Co-Innovation Lab KOBEでのスプリント開発では、Azure OpenAIとAzure AI Speechを活用し、音声による直感的なロボット遠隔操作の実現可能性を確認できました。

生成AIが「人とロボットをつなぐ翻訳者」として機能することで、ITスキルや身体的制約に関わらず、誰もがロボットの遠隔操作に参加できる未来への手応えを感じています。

今後も最新のAI技術を取り入れ、フィジカルAI時代における「人に寄り添うリモートロボティクス」の社会実装を推進していきます。”

イノベーションチャレンジ

本取り組みは、単なるUI改善や音声入力の実験ではなく、「AIが判断し、現実世界を動かす」フィジカルAIの実装例として位置づけられています。

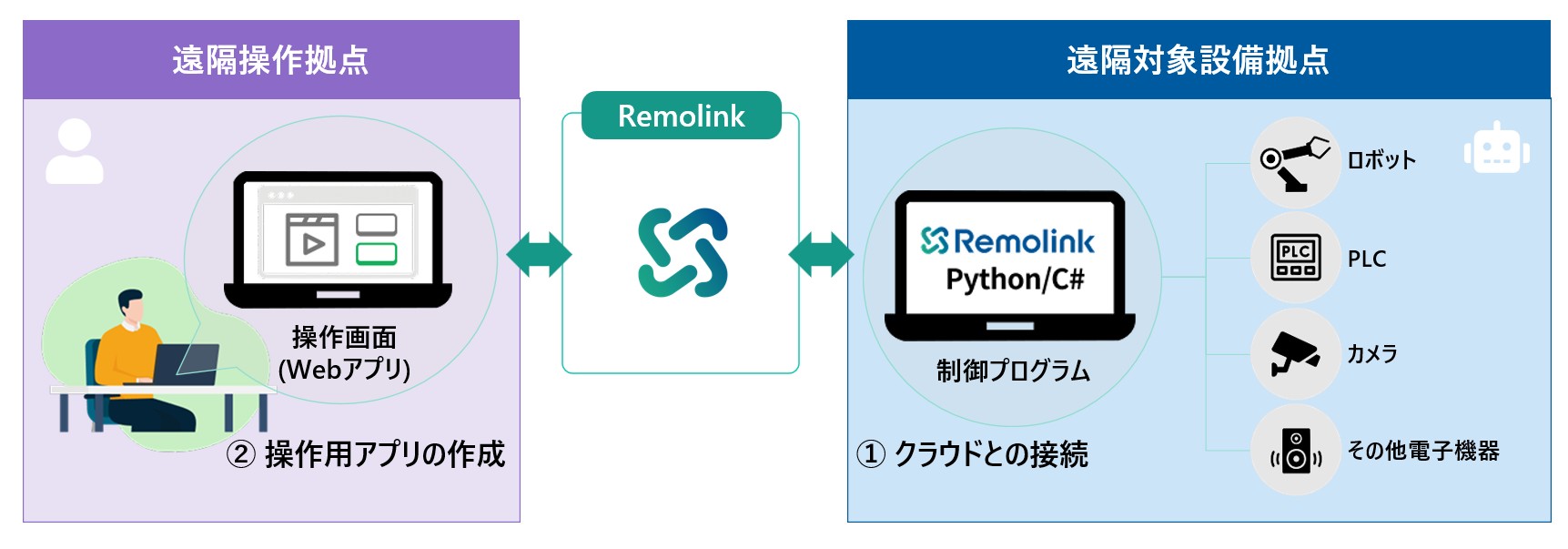

主力プラットフォーム Remolink に対し、

- 音声によるアプリケーション操作

- 生成AIを活用した操作理解・コード生成支援

- ロボット/エッジデバイス制御を前提としたUX検証

を短期間で集中的に検証し、「人に寄り添うリモートロボティクス」という思想を、実際に動く技術として具現化することを目的としました。

なぜ「音声 × 生成AI」なのか

リモートロボティクス株式会社は、川崎重工業株式会社とソニーグループ株式会社の合弁により設立され、

- 自律移動ロボット(AMR)

- 産業機器・PLC

- ネットワークカメラなどのエッジデバイス

を、Webベースで遠隔操作・監視できるプラットフォーム 「Remolink」 を提供しています。

一方で、プラットフォームの進化とともに、

- 操作項目の増加

- UIの高度化・複雑化

が進み、結果として

- 高齢者

- ITに不慣れな現場作業者

- 障がいのある方

にとって、操作ハードルが高まるという課題が顕在化していました。

このジレンマに対し同社が着目したのが、「音声による操作」と「生成AIによる理解・補助」です。

UIを覚えるのではなく、話しかければAIが意図を理解し、判断し、操作を代行する。

この体験こそが、次世代リモートロボティクスに不可欠だと考えました。

人とロボットの“距離”を、AIで縮める

今回のCo-Innovationの本質は、単なる音声認識の導入ではありません。

- 音声で「何をしたいか」を理解し

- Remolink上のUI/ワークフローに正しくマッピングし

- 実際のロボット・デバイス制御に反映する

という、

人間の意図 → デジタル操作 → 物理世界の動作

を一気通貫で成立させる点にありました。

特に、

- ボタン操作

- プルダウン選択

- チェックボックス変更

- カメラ操作(ズーム・切替)

といった、人間には直感的だが、機械には曖昧な操作を、生成AIでどう解釈し、安全かつ正確な制御命令に落とし込むかが重要な論点となりました。

この構造こそが、フィジカルAIの中核であり、「画面内で完結しないAI」の具体例として、高い完成度を示すポイントでした。

In the Lab:プロトタイピング(Sprint開発)

Microsoft AI Co-Innovation Lab KOBEでは、テックコール、デザインシンキングを含むオンボーディングを経て、スプリント開発を実施しました。

ゴール設定

- Remolinkで作成したノーコードアプリを音声で操作できること

- 日本語音声における認識精度・操作精度の検証

- 将来の製品組み込みを見据えた技術選択

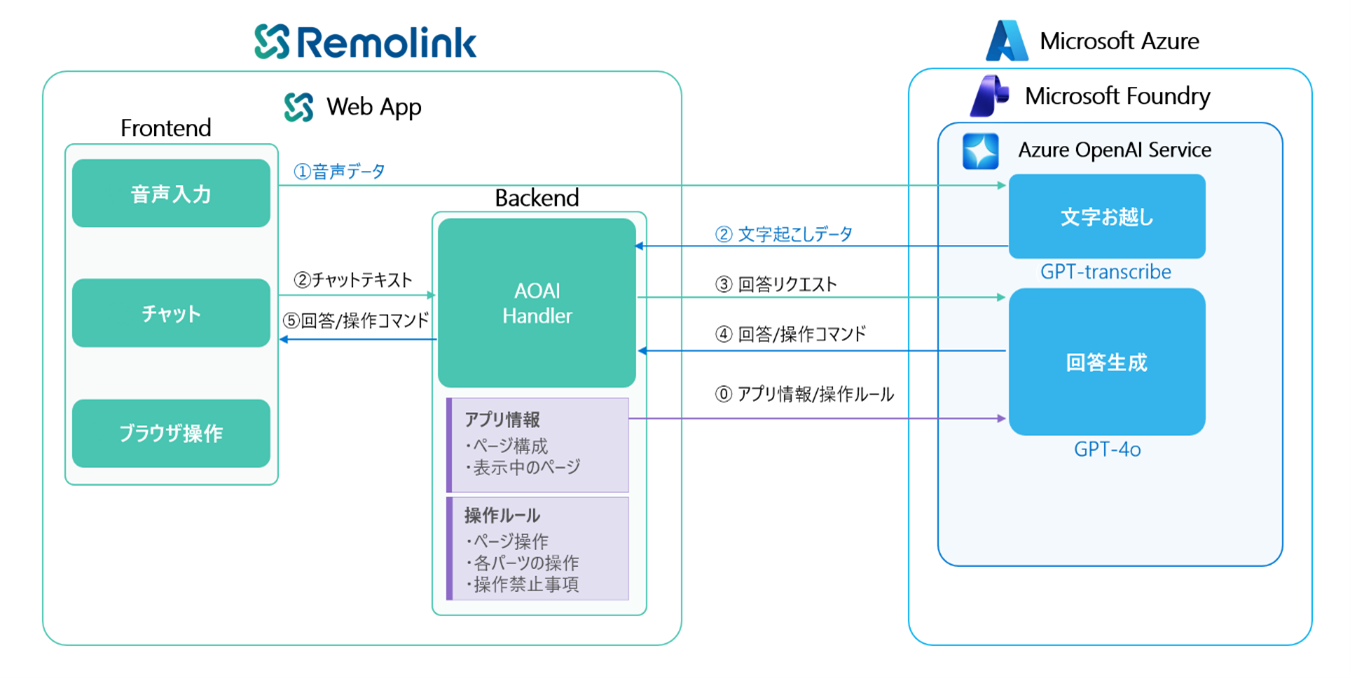

アーキテクチャ

音声認識

- Azure AI Speech

- GPT-4o / GPT-5 transcribe

- 数値表現・日本語文脈理解の精度を重点検証

生成AI(Azure OpenAI)

- 音声指示をUI操作・制御ロジックへ変換

- GPT-4o(低遅延・対話向け)と GPT-5(高推論)の使い分け

Remolink SDK

- 生成された操作ロジックを実際のロボット/デバイス制御に接続

本スプリントでは、完成度よりも「実際に動くこと」を最優先とし、ダミーアプリと実環境に近いRemolink双方で検証を繰り返しました。

技術的な学び:音声 × LLM がもたらす直感的操作

音声入力では特に、

- 「ボタン01を押して」

- 「3番目のアームを動かす」

といった数値を含む操作指示において、従来型STTでは誤認識が発生しやすい課題が確認されました。

これに対し、LLMベースの音声認識(GPT-4o-transcribe)を用いることで、文全体の意味を踏まえた高精度な文字起こしが可能となり、遠隔操作に求められる実用レベルの認識精度を確保できることが示されました。

「理解するAI」とエージェント化

音声から得られた指示は、Azure OpenAI Service の GPT-4o/GPT-5 で解釈されます。

- GPT-4o:低遅延で対話的な操作に最適

- GPT-5:1000行を超えるJSONなど、複雑なメタデータを理解し高度な推論が可能

この特性を踏まえ、UXと推論性能のバランスを重視した設計を行いました。

さらに Azure AI Foundry Agent Service を用いたマルチエージェント構成を試行し、

- UI構成・仕様・制約条件をエージェントに保持

- 自然言語指示を関数呼び出しやSDK操作へ変換

- SDKの使い方に関するQAやコード生成まで一貫支援

という、「人」と「ロボット」の間に考えるAIが介在する構造を実現しました。

これは、AIが判断し、物理的アクションを引き起こすフィジカルAIの代表的な実装パターンです。

成果:プロトタイプで見えた価値

音声によるUI操作が実用レベルで成立

- カメラ操作、フォーム入力、状態変更などを確認

生成AIによるコード生成・操作補助の有効性

- SDK学習コストの低減

- 開発スピードの大幅短縮

アクセシビリティ向上への確かな手応え

- ITスキル差や身体的制約を超えた操作体験の可能性

社内からは、「従来3か月かかっていた検証が、5日間で実現できた」という評価も得られ、今後の製品戦略における重要な示唆となりました。

神戸から社会実装へ — 今後の展望

本取り組みは単なるPoCに留まらず、

- 人材不足

- 遠隔化ニーズの高まり

- Physical AI(AI×実世界)の社会実装

という大きな潮流の中で、「人を中心に据えたロボット操作」という方向性を明確に示すものとなりました。

生成AIを「ロボットを賢くする技術」ではなく、「人とロボットをつなぐ翻訳者・補助者」として位置付けることで、誰もが参加できる遠隔作業環境が、現実的な選択肢となりつつあります。

今後は、

- 音声 × 生成AIの製品組み込み

- ロボットセル・デジタルツインとの連携

- 神戸ラボでの展示・外部発信

を通じ、日本発 フィジカルAIのユースケースとして、より広い産業領域への展開が期待されています。